Сегодня довольно много информации рассмотрим. Поговорим о семантике, о том как её анализировать, и что делать с объявлениями конкурентов.

Я – Илья Исерсон, контекстное агентство MOAB и семантический сервис MOAB Tools.

Анализ семантики конкурентов

Анализ семантики – тема очень специфическая. О ней очень много говорят, пишут. Много инструментов на рынке. Но главное, что нужно понимать: зачем анализируем, чем и как.

Одно из самых распространённых заблуждений на рынке – надо проанализировать конкурентов, значит берём Spywords, заливаем туда домены конкурентов, выгружаем семантику и начинаем что-то с ней делать.

Это наиболее ошибочный, пагубный подход, какой только может быть в этом вопросе.

Я уже не первый раз выпускаю обучающие курсы на эту тему, после одного из предыдущих со мной связались Spywords и поблагодарили за эту информацию, они даже в собственной рассылке приводили эту информацию в том ключе, что то как я это рассказываю полностью совпадает с их видением.

Просто выгружать из Spywords ключи, загружать их в контекстную кампанию, использовать SEO – это не очень правильно. Сейчас мы поговорим, почему.

Чтобы понять, как анализировать семантику, надо понять, как её собирают.

Здесь – самая главная ошибка, какая только может быть.

Чтобы собрать полноценную семантику, которая охватывает все поисковые запросы пользователей, что нужно сделать? Объясню на простом примере, но зато доходчиво: если вы продаете пластиковые окна, вам нужно взять базисный запрос (маркер, маска и т.п. – кто как называет). Надо задать этот запрос к вордстату – у вас выйдет какой-то достаточно большой семантический хвост.

Как правило, собирают вордстат в один уровень – первые 40 страниц. Получают 2000 ключей и начинают думать, что с ними делать. Этот подход

опять же неверный, потому что собираются наиболее частотные запросы.

Как нужно делать правильно?

Нужно собирать в 2 или в 3 уровня, в зависимости от частотности базисного запроса. Если мы говорим о пластиковых окнах, вполне достаточно собрать 2 уровня. Это будет не 2000 запросов, а около 80-100 тысяч.

Затем по этим запросам желательно собрать поисковые подсказки, чтобы менее частотными, более актуальными и свежими ключами это всё дополнить.

Затем эти выборки объединить, проверить их частотность. Убрать запросы, где частотности нет. И уже работать – формировать минус-файл, делать

кластеризацию для формирования рекламных объявлений и т.п. Уже с этой выборкой нужно какие-то задачи решать.

Понятно, что пример очень грубый, в реальности таким методом по запросу пластиковых окон вы соберёте хвост очень большой, который вряд-ли

сможете обработать. На практике мы имеем дело с конкретными ситуациями.

Даже если это пластиковые окна, часто компания, которая с ними работает, продаёт только пластиковые окна определенной фирмы, или только деревянные, – всегда есть более узкая сущность, на которую можно опереться.

Если это окна “Рехау”, соберите в русском, в английском написании ключи. И работайте с ними. Там будут довольно ограниченные выборки – 5-7

тысяч запросов.

Теперь, когда мы понимаем, как правильно собирать, как охватить действительно всё, возникают 2 вопроса:

Как это автоматизировать?

- Можно автоматизировать тем же Кейколлектором, правда придётся немножко поработать.

- Можно пойти в МОАВ Tools, там всё это автоматизировано.

Анализ конкурентов для поиска семантики заключается не в сборе конкретных запросов (конкретное ключевое слово, по которому необходимо рекламироваться). А заключается в поиске новых масок ключевых фраз – новых базисных маркерных запросов, которые вы ранее не учитывали.

Как это работает?

В примере с пластиковыми окнами “Рехау” всё вроде-бы просто. Бренд по-русски и по-английски. Но тут-же возникают запросы «ПВХ рехау», «окна рехау» и т.п. – много других базисов.

Когда речь идёт о пластиковых окнах, это все выглядит просто. Классический пример, о котором я рассказываю – подарочная тематика. Там есть подраздел «подарки начальнику». Это могут быть:

- подарок начальнику

- подарок боссу

- подарок руководителю

- подарок директору

- подарок начальнице

- всё то-же самое, но с презентом, сюрпризом, набор для руководителя, начальника и т.п.

- вещи, связанные с военными (например, подарок полковнику – условно)

Самих этих базисов только по подаркам начальству – масок, по которым можно собрать большой, длинный хвост с большой частотностью и большим охватом разных запросов, – их было несколько десятков. И это только одна подтема была в данном магазине. Там еще были всякие подарки детям, родственникам и т.п.

На практике, когда у вас есть большой проект, или специфические темы, реальной проблемой становится поиск этих маркеров – базисов.

Сам сбор хвостов легко автоматизировать – либо Кейколлектор, либо Пиксель Тулс, или еще другие сервисы есть. А вот поиск этих базисов, которые позволяют увеличить охват, количество людей, которые ищут то, что вам нужно продать, – это действительно проблема, потому что это можно осуществить только вручную.

Для этого как раз лучше и эффективнее всего использовать сервисы анализа конкурентов. Об этом мы сейчас и поговорим.

Принцип работы сервисов анализа конкурентов

Зачастую многие не понимают, как они устроены изнутри.

Наиболее эффективными в этой среде являются сервисы анализа видимости.

Например:

- Serpstat

- Spywords

- Megaindex

У Адвсё и Similarweb немножко другой функционал.

Принцип работы этих сервисов следующий:

- У сервиса есть некая база запросов – миллион, 30, 50, 100 миллионов – не важно. Некая база запросов, к которой можно обращаться. Определенное количество фраз.

- По этим фразам раз в месяц они снимают поисковую выдачу. Что это значит? Робот задаёт эти запросы в поиске Гугла, Яндекса, запоминает все ответы, которые ему отдают все рекламные и органические ссылки.

- Сохранют их себе в базу.

- Когда вы задаёте конкретный домен вашего конкурента, осуществляется обратный поиск – вам выдаются все ключевые запросы, по которым этот домен в выдаче был найден.

Какие тут могут быть погрешности? Мы не знаем, откуда сервисы берут свою базу. Откуда-то они её берут, но источник этой базы нам не известен. Это факт.

Чаще всего это тот-же пресловутый вордстат. Я ни в коем случае не хочу сказать, что это плохо.

Насколько эта база полноценна конкретно для вашей тематики? Насколько она полноценна вообще? Как часто она обновляется, как вообще она обновляется? Возникает множество вопросов и в каждом случае (в каждом сервисе анализа конкурентов) скорее всего будут разные ответы.

Приведу простой пример. Условно, вот вышли новые айфоны, а сервисы еще не спарсили семантику по новым айфонам, не добавили информацию в свою базу и соответственно не сняли информацию с выдачи по ней. Этот анализ будет неинформативен, если вы захотите проанализировать, что ваши конкуренты делают по этой тематике.

Откуда берётся база, насколько часто она обновляется, насколько результат, который отдаётся роботу сервиса видимости отличается от реального

среднего результата, который видят люди за счёт персонализации поиска?

Надо понимать, что каждый конкретный человек обращаясь к поиску, и в рекламе, и в органике видит уже персонализированную выдачу, которая может сильно или не сильно отличаться. Есть какая-то средняя позиция, которая может плавать. Насколько то, что увидел робот при парсинге будет отличаться от реальной средней позиции, мы тоже не знаем. Здесь могут быть существенные отличия.

Какие выводы? Использовать сервисы видимости для прямого анализа – допустим, мой конкурент продвигается по таким-то ключам или у него

видимость гораздо лучше, чем у меня. – это всё очень большая условность.

Ниже мы поговорим о ситуации, когда эти данные становятся на большом объёме более-менее точными, но прямое использование этих данных крайне не рекомендуется, т.к. они очень примерны и условны.

Как правильно работать с сервисами анализа конкурентов

Как нивелировать эту условность, которую мы получаем в сервисах выдачи?

Прежде всего составьте объективный список конкурентов.

Через Spywords или Similarweb, на ваше усмотрение. Не суть. Будет примерно тот-же список. В Spywords в узких тематиках он будет чуть получше (ну и конечно удобство русского интерфейса).

Каких-то конкурентов вы знаете сами. Как правило, люди всегда мониторят действия 5-7 своих конкурентов. Но не помешает добавить еще тех, кто на второй странице ранжируются, менее популярные, работают в смежных регионах и т.п. Как правило, 20 сайтов более чем достаточно.

Это очень просто сделать: забиваете в Spywords ваш сайт, ранжируете по потенциальному трафику сайты, которые пересекаются с ним по ядру и отбираете те, которые действительно являются конкурентами, потому что там вы встретите агрегаторы – они вам не конкуренты, информационные сайты, магазины, с которыми вы не можете тягаться.

Понятно, если вы продаёте постельное белье, и ОЗОН продаёт постельное белье тоже, бессмысленно себя с ним сравнивать, даже если вы в одной с ним выдаче. Вы в любом случае ранжируетесь по разным паттернам, – что в по рекламе, что в органике.

Отбирайте именно прямых конкурентов, семантика которых значительно пересекается с вашей. Составляйте список и выкачивайте из него семантику, из того же Spywords или кому чем нравится. Далее экспортируем эту семантику, убираем дубли и заливаем это в один файл.

У нас получается большой список на 20-30 тысяч ключевых слов (условно).

Теперь добавляем эту семантику в Кейколлектор.

Там есть такой инструмент «анализ групп» (на вкладке «Данные») – туда заливаем. Группируем её, разбиваем на группы за счёт простого частотного словаря. (Выбираем анализировать «по фразам»). Вся эта семантика разбивается на группы. Если у вас идёт речь о “подарках начальнику”, например, там есть группа «ручки» – «ручка в подарок начальнику», «ручка начальнику купить» и т.п. – все фразы со словом «ручка начальнику» будут разбиты по группам.

На эти группы удобно смотреть и отбирать из них потенциальные маркеры. Грубо говоря, какой-то из ваших конкурентов сделал посадочную

страницу по “ручкам в подарок начальнику”, но назвал её «Ручка в качестве сюрприза для начальника». Эта страница по каким-то ключам вылезла – вы видите эту группу ключей, по которым сервис видимости отследил наличие этого конкурента.

Соответственно, вы из этой группы из запроса «ручка в подарок начальнику» можете выдернуть основу «подарок начальнику» – идея для нового базисного запроса.

Когда работаешь с Кейколлектором, очень хорошо видны вот эти основы, их там действительно много и они непредсказуемы.

Достаточно посмотреть только 20% этого частотного словаря, чтобы увидеть идеи для новых масок ключевых фраз. После того как вы увидели новые базисы, синонимы того-же, что вы продаёте, о которых вы раньше не догадывались, вы идёте с ними в вордстат и в подсказки. И уже там собираете статистически достоверный, полный массив запросов, с которыми вы будете работать. Вот так это работает.

Условность, которая лежит в основе механики самих сервисов видимости, не позволяет напрямую использовать эти данные. А если вы их используете, вы наверняка столкнётесь с разными проблемами:

- с неполнотой ядра (будут не все минус-слова учтены);

- не все кластеры будут подготовлены, соответственно под какие-то типы запросов у вас не будет релевантных объявлений, посадочных страниц (лендингов) под эту контекстную рекламу и т.п.

Какой инструмент по итогу использовать?

На данный момент в ру-сегменте наиболее полную статистику отдает Spywords, у него база в районе 100 миллионов. Сопоставимую базу сделали Букварикс.

Это наиболее приоритетные продукты с точки зрения видимости в ру-сегменте, у них наиболее полная база, наибольший результат при работе

со среднестатистическими магазинами, не очень большими, с трафиком между 200-2000 человек в день.

Такие результаты они нормально отрабатывают, с известной погрешностью, – она ощутима и большая, реальное ядро этих магазинов может быть в 2-3 раза больше, но по крайней мере общее представление вы получите.

Будьте очень аккуратны, если у вас региональный проект

Региональных баз там нет! А известно, что региональные выдачи очень сильно различаются по коммерческим запросам.

Насколько мне известно, у этих сервисов сейчас отрабатывает база РФ, Москва и Питер. Если у вас проект в Екатеринбурге, вам будет мало толку от такого анализа. У вас погрешность будет ещё больше, если вы будете эти данные использовать напрямую.

Если вы будете пытаться использовать эти данные так, как я рассказываю, тогда можете какой-то толк извлечь. Но в этом случае необходимо скорее московских конкурентов анализировать или какие-то федеральные проекты, потому что по вашим локальным проектам у них просто не будет данных.

Сервисы не анализируют выдачу в Екатеринбурге или Ярославле, например. Это еще раз пробивать те-же 100 миллионов – это никто не потянет. Но опять же – в данном случае я предостерегаю исключительно региональные проекты.

У Serpstat больше региональных выдач. У них несколько регионов – мск, спб и что-то еще. Но их недостаток – очень

маленькая база, всего 12-15 миллионов.

Какие-то более-менее вменяемые результаты он даёт только на больших сайтах, которые просто больше попадают в выдачу. На проектах с трафиком до нескольких тысяч в сутки очень бедная выдача, очень мало запросов. Использовать это очень затруднительно.

Для Serpstat ру-рынок вторичен, база очень маленькая.

Мегаиндекс вообще не понятно как работает. Там существуют какие-то системные проблемы и с техподдержкой, и с функционалом, и со всем остальным. Их база – не фонтан.

Similarweb не используют выдачу, не снимают данные как мы уже рассмотрели. Они покупают данные метрик, аналитикса (статистик сайтов), используют данные браузерных плагинов (своих и чужих).

Для мелких сайтов там ловить нечего. Очень примерные данные будут. Если у вас и у коллег посещаемость хотя бы от 1000 уников в день, еще можно хоть как-то примерно сравнивать, а всё, что меньше 1000 в сутки – это настолько примерные оценки, что с реальностью они могут быть вообще никак не связаны.

Даже на большем трафике могут быть отдельные сегменты, где дефицит данных и это не очень похоже на правду. В среднем, чем больше трафик, тем больше похоже на правду.

У меня по проектам, где трафик 20-30 тысяч уников в сутки, – там они угадывают с незначительной погрешностью. 10-20%. А когда я начинаю брать проекты по 1000-2000 хостов в сутки, там разница может быть и 40-50% – это уже за гранью.

Адвсё – самая бедная база семантики, очень мало результатов. Идут по той же модели, используют свой браузерный плагин. Но все мы знаем судьбу браузерных плагинов – их сейчас практически никто не ставит, они развиваются плохо.

У всех этих инструментов есть существенные минусы, который определяется методикой съема позиций выдачи. Но среди них есть те, которые дают более правдоподобные результаты, которые можно с некоторыми погрешностями использовать. Просто надо знать, как что работает, у кого какая база и как часто она обновляется.

Категорически не рекомендую строить кампанию на основе прямых выгрузок из сервисов видимости

В конкретных сегментах может быть очень большой дефицит запросов. Вы должны находить какие-то новые маркеры, базисы, новые поисковые маски. И уже по ним собирать достоверную семантику, которая охватит все возможные минуса и все возможные кластеры.

Собирать из Вордстата и подсказок. Из Вордстата желательно работать с глубиной 2 или 3 (Кейколлектором можно настроить любую глубину). Можно в МОАВ тулс пойти – там есть глубина 1 и 2.

Плюс поисковые подсказки. Мы собрали 10000 запросов – желательно каждый из них прогнать по подсказкам и собрать расширения, проверить по

ним частотность, чтобы статистически достоверное ядро получить.

Какие данные конкурентов важны

В данный момент мы вынуждены говорить о том, что конкретной рекламной позиции по сути не существует.

Ваш сайт может плавать по выдаче как угодно – в зависимости от того, как это сочтёт нужным персонализация. Кому-то вас покажут, кому-то нет. Где-то вы будете на первом месте, где-то – на третьем, в зависимости от конкретного пользователя, конкретного запроса и конкретной ситуации.

Семантика очень сильно разрастается, очень много микро-НЧ уникальных, которых ранее никто не задавал, – по ним вообще невозможно предугадать выдачу.

Как работать с анализом объявлений?

Мы начали составлять таблицу, в которой собираем все УТП (“уникальные торговые предложения” – то, за счёт чего они пытаются выделиться в своей нише) конкурентов.

Понятно, что всё там не соберешь, – кого-то из конкурентов тебе просто не покажут. Но основные ключевые вещи можно собрать. Здесь у нас 10 текстовых полей, приведённых по вероятности показа:

- заголовок;

- 2 заголовок;

- описание;

- отображаемая ссылка;

- быстрые ссылки;

- уточнения;

- расширения;

- адрес, метро, телефон.

Заголовок у нас будет всегда, подзаголовок будет почти всегда, описание будет всегда, а отображаемая ссылка – нет. Быстрые ссылки тоже кто-то

заполняет, а кто-то нет. Расширения, адрес, метро, телефон – тоже.люди не всегда указывают в объявлении.

Те же расширения, уточнения могут быть показаны в зависимости от конкретного запроса, а могут быть не показаны. Речь идёт о том, чтобы распределить список УТП таким образом по объявлению, чтобы сначала собрать список УТП конкурентов, которые они используют в своих объявлениях.

Составить список своих УТП.

Как составить и распределить список УТП на примере компании по настройке и ведению рекламных кампаний в Яндексе и Гугле:

Заголовок: Ключевое слово (в случае рекламы на поиске) и/или суть услуги + призыв к действию (при рекламе в РСЯ).

Описание: Семантика до 30000 ключей, бесплатный прогноз реального бюджета и заявок

Быстрые ссылки и их описания:

- рост конверсии на 100%

- единоразовый платёж

- бесплатный аудит сайта

- всё на вашем аккаунте

- 1 месяц ведения бесплатно

- ретаргетинг ВК и FB

- гарантия чистоты трафика

Кто не знает, УТП – это уникальное торговое предложение, то, чем вы можете «соблазнить» клиента, который желает у вас что-то приобрести.

Собрать список УТП конкурентов – из выдачи, что они используют в своих объявлениях. Зачастую ничего особо уникального там нет – обычно есть 2-3 игрока в нише, которые действительно что-то интересное могут предложить. Остальные действуют по шаблону.

Добавить в этот список ваше УТП, которое вы можете клиенту предложить – вы обязательно должны чем-то отличаться.

Зачастую, общаешься с предпринимателями и спрашиваешь про их УТП, отвечают: «ну мы ставим межкомнатные двери, какие у нас УТП… ну

доставка бесплатная, ну дёшево, ну мастера квалифицированные». Неинтересная история.

Если вы работаете с бизнесом, с них обязательно нужно требовать какое-то УТП. Если вы работаете с бизнесом и вам говорят, что у них УТП такое же как у всех, тогда надо говорить, что какое УТП, такой и результат. Почему у вас должны покупать, если вы точно такой же как и все? Будут покупать также – не особо.

Надо заставлять бизнес думать. Придумывать УТП вместе или пусть сами придумывают. Это зависит от вашей финансовой модели, по которой вы работаете с клиентами.

Затем, когда совмещаются удачные решения конкурентов и уникальные для вас решения, эти УТП распределяются по наиболее вероятным для показа полям объявления. Если у вас там ключевое слово влезает в первый заголовок, то во второй заголовок можно поставить какое-то наиболее

критичное, важное УТП вставить.

Приоритет 2 – в описание. В быстрые ссылки – с приоритетом 3. В уточнения, расширения – какие-то уже менее приоритетные вещи, потому что они будут показаны не всегда – надо об этом помнить.

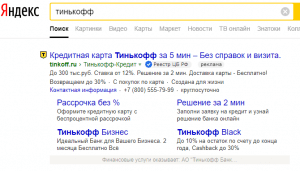

Лайфхак с витальными запросами.

Витальные запросы – это запросы, которые прямо указывают на тот или иной проект, сайт, организацию. Например, «Тинькофф».

По витальным запросам показываются расширенные объявления, где видны как быстрые ссылки, так и их описание. Т.е. это возможность не только

посмотреть, какие описания к быстрым ссылкам показываются, т.к. не все эти описания заполняют в принципе. Не у всех есть витальные запросы. Для небольшого магазина таких запросов не будет. Само по себе то, заполнено ли описание по быстрым ссылкам, говорит об уровне конкурента – насколько он вообще внимательно подходит работе.

Во-вторых, это позволяет посмотреть расширенные, более продуманные версии УТП, если конкурент написал туда что-то интересное, а не шаблонные вещи. Какие-то идеи можно оттуда брать.

Берете конкретного конкурента – забиваете его название в поиск. Если они заморочились, по этому запросу будет показано расширенное объявление, с описаниями и быстрыми ссылками. Смотрите, анализируете.

Сокращение времени на создание объявлений

Вас везде будут учить, что всё нужно делать максимально хорошо, качественно.

Вот у вас 1000 объявлений, давайте к каждому подберём наиболее релевантные быстрые ссылки… звучит это, конечно, правильно. Но в реальности, когда у вас семантика 20-30 тысяч фраз (для московского интернет-магазина это нормальная ситуация, это не очень много), почистили,

сформировали минус-файл. Осталось 10000 фраз, они превратились у вас в 700-1200 кластеров – т.е. объявлений. Подобрать релевантные быстрые ссылки для каждого объявления – очень долгий процесс.

Да, для каждого кластера необходимо подбирать релевантную посадочную страницу. Это даже не обсуждается. Это можно частично автоматизировать, если у вас многостраничный сайт с хотя бы минимально проработанными заголовками. Но делать индивидуальные быстрые ссылки для каждого объявления на большом объеме – экономически неэффективно.

Проще разработать 2-5 универсальных комплектов, в зависимости от ключевых слов.

Например, сегмент для “светодиодного освещения”, для “освещения из обычных ламп накаливания”, “для ретро-лампочек”, и заливать их везде

типовые – это экономит время, которое лучше оставить для аналитики, оптимизации, работу с отделом продаж, еще какие-то доп.активности, потому что семантики всегда больше, чем вас.

Если у вас какая-то очень узкая ниша (мы как-то работали – мобильные скотобойни), где семантики практически нету, да, там можно 20-40

объявлений сделать вручную. Это экономически оправдано. А когда у вас большой ассортимент товаров, не стесняйтесь идти на разумные жертвы –

жертвовать второстепенным ради экономии времени в пользу более важных вещей, как например оптимизация кампании после запуска, улучшение

посадочных страниц, конверсии.

Старайтесь тратить время на наиболее приоритетные задачи, не тоните в перфекционизме – ни к чему хорошему это не приведет

Анализ посадочных страниц конкурентов

Рекламные выдачи могут делиться на несколько групп по широким тематикам, в каждой из которых преобладает определённый тип посадочных страниц:

- Почти всегда будет лендинг (одностраничник) – бады, кредиты, мфо.

- Смешанные (вы увидите в выдаче как многостраничные сайты, так и лендинги) – пластиковые окна, услуги, натяжные потолки, двери, ремонт.

- Почти всегда многостраничник – товарка, e-commerce.

Здесь не надо плыть против ветра. Если в вашей тематике в рекламной выдаче одни лендинги по всем сегментам ключевых фраз (просто руками

покликайте), не надо делать многостраничные сайты. Не нужно. Люди привыкли видеть лендинги. Они привыкли к определённой модели – зашёл,

там большая форма, надо что-то вбить и тебе скажут, дадут денег или нет, образно (пример с микрофинансами конечно-же).

Или вы заходите в какую-то нишу, где классический e-commerce с большим количеством посадочных страниц. Вы видите, что там всё разбито по посадочным – “голландские”, “немецкие тюльпаны” и т.п. – под каждую узкую сущность отдельная посадочная страница с отдельной группой товаров, отдельным заголовком и т.п., то не желательно в такую нишу заходить лендингом. Если уж заходите, то обязательно прорабатывайте текстовые подмены – это хоть как-то скомпенсирует.

Анализ сайтов-конкурентов

У меня есть очень подробно проработанный чек-лист – 90 параметров, по которым можно проанализировать сайты конкурентов, как они работают с

конверсией: чек лист анализа сайта конкурентов

И в этом же чек-листе есть список параметров, по которому можно проанализировать отдел продаж конкурентов.

Мы иногда составляем список конкурентов и звоним им, представляясь клиентами. И по этому чек-листу проставляем плюсы и минусы – как реагирует менеджер на те или иные вопросы, запросы товаров, потребительские сомнения, боли, опасения и т.п.

Очень полезно сравнивать конкурентов и потом в собственный отдел продаж позвонить, посмотреть, как они работают.

Тут же становятся видны проблемные моменты, которые не дорабатываете вы, и которые недорабатывают конкуренты. И то, что конкуренты не

дорабатывают – это в первую очередь ваше УТП, благодаря которому вы можете добиться лидерства.

Вопросы – ответы

Вопрос: Как делать анализ групп по фразам Spywords?

Ответ: Вы делаете выгрузку из Spywords, заливаете в Кейколлектор, нажимаете «Анализ групп».

Он вам выдаёт разбивку по группам. Все ключевые фразы сгруппированы по словам в них входящим. Если в вашем семантическом

ядре есть, например, 10 фраз, которые содержат слово «жёлтый» – все они будут объединены в одну группу.

Когда вы анализируете большое количество разноплановых конкурентов с разными стратегиями, с немного разными подходами к оптимизации, с

разными специалистами – вы с большой вероятностью столкнетесь с большим количеством синонимов. Это будут и «подарки» начальнику, и «сувениры», и «сюрпризы» и т.п. эти все варианты будут проскальзывать.

Тонкий момент заключается в том, чтобы глядя на конкретные ключевые слова, вычленять из них основу, маркер, который можно задать Вордстату и получить расширенную выборку.

Из, к примеру, «ручка в подарок начальнику» увидеть «подарок начальнику» – и уже по ней собрать расширенную статистику.

Вопрос: Что такое кластеризация, кластер?

Ответ: У вас есть какой-то массив запросов. Например, «пластиковые окна». Когда вы смотрите на продукт, услугу, товар, людям без опыта она представляется неким монолитом – вот есть пластиковые окна, и люди ищут «пластиковые окна купить» и «пластиковые окна цены».

На самом деле это не так. Там очень большой хвост уникальных запросов. С

разных сторон эту тему они раскрывают – “деревянные”, “стальные”, еще какие-то, с 2-3-10 стеклами, одного или другого производителя, в таком-то городе и т.п.

Таких разных дополнений очень много – это образует тематический хвост, который может быть очень длинным. Соответственно, когда у нас есть этот семантический хвост, большая часть трафика приходится именно на семантический хвост.

Важно понимать, что сам по себе этот базис минимальную часть трафика агрегирует – 1-2% обычно. Соответственно, этот хвост можно разбить по физическим сущностям, например, “деревянные окна из сосны”, ольхи, березы (условно), “алюминиевые окна”, по разным производителям, городам, районам.

Всё это разные физические сущности или разные проблемы пользователя, на которые должны быть даны разные ответы. Это называется интент – проблема, боль пользователя, выраженная в группе поисковых запросов.

Например, те же «деревянные окна из сосны» могут быть 10-30 запросов, которые объединяются в одну сущность. Их можно объединить в кластер,

т.к. по сути, это одно и то же – «окна из сосны цена», «окна из сосны купить», «окна из сосны отзывы». Их можно объединить в одно объявление,

сделать под него посадочную страницу, где предложить эти окна и дать по ним информацию.

Сама группа этих однотипных запросов, подразумевающих одну физическую сущность, и будет называться кластером.

Вопрос: Чем отличается ключевое слово и поисковая фраза?

Ответ: В основе этого запроса лежит история про то, что есть некая сущность, которая есть в рекламном аккаунте («пластиковые окна купить»), и есть некий набор поисковых запросов, которые в результате показа этого объявления вешаются на исходный, существующий в аккаунте набор фраз.

Если у нас в аккаунте объявление «пластиковые окна купить» транслируется полгода на достаточных для спец. размещения ставках, то через полгода мы выкачаем из этого аккаунта в 10-15 раз больше ключевых слов, по которым реально это объявление транслировалось.

Одну сущность кто-то называет поисковой фразой, поисковым запросом. Я разные встречал варианты. Я бы не сказал, что есть какая-то общепринятая трактовка. Кто как хочет, тот так и называет.

Главное, чтобы вы правильные вещи имели ввиду. Чтобы вы понимали, что даже если вы проработали низкочастотку, работаете с запросом с частотностью 15-20 по вашему региону, все равно будут еще более расширенные уникальные запросы, которые вы никогда ниоткуда не выкачаете. И по ним в отдельности нужно будет разбираться, смотреть, насколько они целевые, что надо минусовать и т.п.

Какой бы узкий запрос вы не задали, если по нему есть какое-то минимальное количество показов, вы всегда потом из отчета того же Директа

выкачаете по этому запросу более расширенные варианты. Их действительно много.

Вопрос: Как узнать примерный бюджет конкурентов на контекстную рекламу?

Ответ: Можно пойти в тот же Spywords, но там эти данные будут довольно приблизительные и вы должны понимать, что это примерная информация. Имеет смысл делать +10-40% к тому бюджету конкурента, что вы увидите.

Если у вас есть своя статистика, я бы поступил так. Посмотрел бы ядро конкурентов. На основе частотности ядра попробовал бы прикинуть

реальный трафик, который конкурент получает, и потом умножил бы на ваши данные по стоимости клика. Но это тоже очень примерная история. Прямо вот примернее некуда. Разбег может быть 200%, а может быть 30%

Вопрос: Чем посадочная страница отличается от обычной? Сайт нужно делать из совокупности страниц?

Ответ: Посадочные страницы почти ничем не отличаются от обычных. На посадочную вы ведёте из какого-то объявления. Вы выбираете релевантную страницу и на неё ведёте трафик. Она называется «посадочная», потому что на неё «приземляются» люди из рекламы.

Кластеризация для СЕО и для контекста немного различаются. Но в нормальной ситуации сайт, оптимизированный под органическую выдачу, с нормально настроенными кампаниями, объявления они будут лить на те же сеошные кластеры, посадочные. Если всё правильно кластеризовано, там не будет никакой проблемы.